Reseña Historia de la

Informática Informática

La informática es una ciencia que estudia métodos, procesos, técnicas, con el fin de almacenar, procesar y transmitir información y datosen formato digital. La informática se ha desarrollado rápidamente a partir de la segunda mitad del siglo XX, con la aparición de tecnologías tales como el circuito integrado, Internet y el teléfono móvil.

ORÍGENES

En los inicios del proceso de información, con la informática sólo se facilitaban los trabajos repetitivos y monótonos del área administrativa. La automatización de esos procesos trajo como consecuencia directa una disminución de los costos y un incremento en la productividad. En la informática convergen los fundamentos de las ciencias de la computación, la programación y metodologías para el desarrollo de software, la arquitectura de computadores, las redes de computadores, la inteligencia artificial y ciertas cuestiones relacionadas con la electrónica. Se puede entender por informática a la unión sinérgica de todo este conjunto de disciplinas. Esta disciplina se aplica a numerosas y variadas áreas del conocimiento o la actividad humana, como por ejemplo: gestión de negocios, almacenamiento y consulta de información, monitorización y control de procesos,industria, robótica, comunicaciones, control de transportes, investigación, desarrollo de juegos, diseño computarizado, aplicaciones / herramientas multimedia, medicina, biología,física, química, meteorología, ingeniería, arte, etc. Puede tanto facilitar la toma de decisiones a nivel gerencial (en una empresa) como permitir el control de procesos críticos. Actualmente es difícil concebir un área que no use, de alguna forma, el apoyo de la informática. Ésta puede cubrir un enorme abanico de funciones, que van desde las más simples cuestiones domésticas hasta los cálculos científicos más complejos. Entre las funciones principales de la informática se cuentan las siguientes:

- Creación de nuevas especificaciones de trabajo

- Desarrollo e implementación de sistemas informáticos

- Sistematización de procesos

- Optimización de los métodos y sistemas informáticos existentes

- Facilita la automatización de datos

ORIGEN DE LA PALABRA INFORMATICA:

En 1957 Karl Steinbuch añadió la palabra alemana Informatik en la publicación de un documento denominado Informatik: Automatische Informationsverarbeitung (Informática: procesamiento automático de información). En ruso, Alexander Ivanovich Mikhailov fue el primero en utilizar informatik con el significado de «estudio, organización, y la diseminación de la información científica», que sigue siendo su significado en dicha lengua.[cita requerida]. En inglés, la palabra Informatics fue acuñada independiente y casi simultáneamente por Walter F. Bauer, en 1962, cuando Bauer cofundó la empresa denominada «Informatics General, Inc.». Dicha empresa guardó el nombre y persiguió a las universidades que lo utilizaron, forzándolas a utilizar la alternativa computer science. La Association for Computing Machinery, la mayor organización de informáticos del mundo, se dirigió a Informatics General Inc. para poder utilizar la palabra informatics en lugar de computer machinery, pero la empresa se negó. Informatics General Inc. cesó sus actividades en 1985, pero para esa época el nombre de computer science estaba plenamente arraigado. Actualmente los angloparlantes utilizan el término computer science, traducido a veces como «Ciencias de la computación», para designar tanto el estudio científico como el aplicado; mientras que designan como information technology (o data processing, traducido a veces como «tecnologías de la información», al conjunto de tecnologías que permiten el tratamiento automatizado de información.

El vocablo Informática es proveniente del francés informatique, acuñado por el ingeniero Philippe Dreyfus en 1962, es acrónimo de las palabras information y automatique. En lo que hoy conocemos como informática confluyen muchas de las técnicas y de las máquinas que el hombre ha desarrollado a lo largo de la historia para apoyar y potenciar sus capacidades de memoria, de pensamiento y de comunicación.

La informática se aplica a numerosas y variadas áreas, como por ejemplo: gestión de negocios, almacenamiento y consulta de información, monitorización y control de procesos, robots industriales, comunicaciones, control de transportes, investigación, desarrollo de juegos, diseño computarizado, aplicaciones/herramientas multimedia, etc.

En la informática convergen los fundamentos de las ciencias de la computación, la programación y las metodologías para el desarrollo de software, la arquitectura de computadores, las redes de datos como Internet, la inteligencia artificial, así como determinados temas de electrónica. Se puede entender por informática a la unión sinérgica de todo este conjunto de disciplinas.

El concepto de informática viene dado de la conjunción de dos palabras: Información y automática. En tanto que en inglés se habla de conceptos tales como Computer Science, Electronic Data Processing, etc..

Según la el Diccionario de la Real Academia Española RAE es el: "Conjunto de conocimientos científicos y técnicas que hacen posible el tratamiento automático de la información por medio de ordenadores".

Philippe Dreyfus

En 1962 se acuñó el nuevo término Informática. en origen Hispano.

En inglés, la palabra Informatics fue acuñada independiente y casi simultáneamente por Walter F. Bauer, en 1962, cuando Bauer cofundó la empresa denominada «Informatics General.

La palabra Informática fue creada en 1962; su expresión original era Informatique, dado que su país de origen era Francia y esta formado por una contracción de palabras Information y Automatique.

En el año 1968 el término fue adoptado en el mundo de habla hispana y su modificación derivó en INFORMATICAcomo contracción de las palabras Información Automática.

PIONEROS DE LA COMPUTACIÓN

- Creación de nuevas especificaciones de trabajo

- Desarrollo e implementación de sistemas informáticos

- Sistematización de procesos

- Optimización de los métodos y sistemas informáticos existentes

- Facilita la automatización de datos

En 1957 Karl Steinbuch añadió la palabra alemana Informatik en la publicación de un documento denominado Informatik: Automatische Informationsverarbeitung (Informática: procesamiento automático de información). En ruso, Alexander Ivanovich Mikhailov fue el primero en utilizar informatik con el significado de «estudio, organización, y la diseminación de la información científica», que sigue siendo su significado en dicha lengua.[cita requerida]. En inglés, la palabra Informatics fue acuñada independiente y casi simultáneamente por Walter F. Bauer, en 1962, cuando Bauer cofundó la empresa denominada «Informatics General, Inc.». Dicha empresa guardó el nombre y persiguió a las universidades que lo utilizaron, forzándolas a utilizar la alternativa computer science. La Association for Computing Machinery, la mayor organización de informáticos del mundo, se dirigió a Informatics General Inc. para poder utilizar la palabra informatics en lugar de computer machinery, pero la empresa se negó. Informatics General Inc. cesó sus actividades en 1985, pero para esa época el nombre de computer science estaba plenamente arraigado. Actualmente los angloparlantes utilizan el término computer science, traducido a veces como «Ciencias de la computación», para designar tanto el estudio científico como el aplicado; mientras que designan como information technology (o data processing, traducido a veces como «tecnologías de la información», al conjunto de tecnologías que permiten el tratamiento automatizado de información.

PIONEROS DE LA COMPUTACIÓN

Leave a Comment

Gottfried Wilkelm von Leibniz (1646-1716). Cincuenta años después de que Pascal creara su calculadora mecánica, Von Leibniz construyó una máquina que podía multiplicar y dividir, sumar y restar.

Charles Babbage (1791-1871). Fue un hombre con una visión muy anticipada a su época. En 1833 Babbage propuso una máquina, la “máquina de diferencias”, que básicamente era una computadora mecánica. Si la tecnología de esa época hubiera estado en el nivel del genio de Babagge, él hubiera podido construir la primera computadora (¡hace más de 150 años¡).

Ada Auguste Byron, Condesa de Lovelance (1815-1852). Hija del poeta inglés, Lord Byron, Lovelace corrigió errores de la obra de Babbage, propuso el código binario en lugar del sistema decimal que usaba Babbage y escribió descripciones de sus planes para usar el sistema de tarjetas perforadas para entrada, salida y programación.

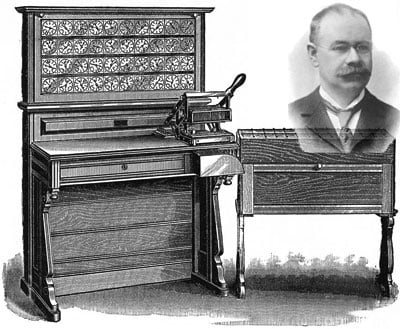

Herman Hollerith (1860-1929). Hollerith concibió las técnicas de tarjetas perforadas para el procesamiento de datos. En 1896 fundó que posteriormente se unieron para formar la IBM.

| |||||||||||||

Los Primeros Ordenadores

Analógicos:

Los ordenadores analógicos comenzaron a construirse a principios del siglo XX. Los primeros modelos realizaban los cálculos mediante ejes y engranajes giratorios. Con estas máquinas se evaluaban las aproximaciones numéricas de ecuaciones demasiado difíciles como para poder ser resueltas mediante otros métodos. Durante las dos guerras mundiales se utilizaron sistemas informáticos analógicos, primero mecánicos y más tarde eléctricos, para predecir la trayectoria de los torpedos en los submarinos y para el manejo a distancia de las bombas en la aviación.

El ordenador analógico es un dispositivo electrónico o hidráulico diseñado para manipular la entrada de datos en términos de, por ejemplo, niveles de tensión o presiones hidráulicas, en lugar de hacerlo como datos numéricos. El dispositivo de cálculo analógico más sencillo es la regla de cálculo, que utiliza longitudes de escalas especialmente calibradas para facilitar la multiplicación, la división y otras funciones. En el típico ordenador analógico electrónico, las entradas se convierten en tensiones que pueden sumarse o multiplicarse empleando elementos de circuito de diseño especial. Las respuestas se generan continuamente para su visualización o para su conversión en otra forma deseada.

2. Electrónicos:

Durante la II Guerra Mundial (1939-1945), un equipo de científicos y matemáticos que trabajaban en Bletchley Park, al norte de Londres, crearon lo que se consideró el primer ordenador digital totalmente electrónico: elColossus. Hacia diciembre de 1943 el Colossus, que incorporaba 1.500 válvulas o tubos de vacío, era ya operativo. Fue utilizado por el equipo dirigido por Alan Turing para descodificar los mensajes de radio cifrados de los alemanes. En 1939 y con independencia de este proyecto, John Atanasoff y Clifford Berry ya habían construido un prototipo de máquina electrónica en el Iowa State College (EEUU). Este prototipo y las investigaciones posteriores se realizaron en el anonimato, y más tarde quedaron eclipsadas por el desarrollo del Calculador e integrador numérico electrónico (en inglés ENIAC, Electronic Numerical Integrator and Computer) en 1945. El ENIAC, que según se demostró se basaba en gran medida en el ordenador Atanasoff-Berry (en inglés ABC,Atanasoff-Berry Computer), obtuvo una patente que caducó en 1973, varias décadas más tarde.

La primera computadora electrónica comercial, la UNIVAC I, fue también la primera capaz de procesar información numérica y textual. Diseñada por J.Presper Eckeret y John Mauchly, cuya empresa se integró posteriormente en Remington Rand, la máquina marcó el inicio de la era informática.

La velocidad y la potencia de cálculo de los ordenadores digitales se incrementan aún más por la cantidad de datos manipulados durante cada ciclo .Si un ordenador verifica sólo un conmutador cada vez, dicho conmutador puede representar solamente dos comandos o números. Así, ON simbolizaría una operación o un número, mientras que OFF simbolizará otra u otro. Sin embargo, al verificar grupos de conmutadores enlazados como una sola unidad, el ordenador aumenta el número de operaciones que puede reconocer en cada ciclo. Por ejemplo, un ordenador que verifica dos conmutadores cada vez, puede representar cuatro números (del 0 al 3), o bien ejecutar en cada ciclo una de las cuatro operaciones, una para cada uno de los siguientes modelos de conmutador: OFF-OFF(0), OFF-ON (1), ON-OFF (2) u ON-ON (3). En general, los ordenadores de la década de 1970 eran capaces de verificar 8 conmutadores simultáneamente; es decir, podían verificar ocho dígitos binarios, de ahí el término bit de datos en cada ciclo.

Un grupo de ocho bits se denomina byte y cada uno contiene 256configuraciones posibles de ON y OFF (o 1 y 0). Cada configuración equivale a una instrucción, a una parte de una instrucción o a un determinado tipo de dato; estos últimos pueden ser un número, un carácter o un símbolo gráfico. Por ejemplo, la configuración 11010010 puede representar datos binarios, en este caso el número decimal 210 , o bien estar indicando al ordenador que compare los datos almacenados en estos conmutadores con los datos almacenados en determinada ubicación del chip de memoria. El desarrollo de procesadores capaces de manejar simultáneamente 16, 32 y 64 bits de datos ha permitido incrementar la velocidad de los ordenadores. La colección completa de configuraciones reconocibles, es decir, la lista total de operaciones que una computadora es capaz de procesar, se denomina conjunto, o repertorio, de instrucciones. Ambos factores, el número de bits simultáneos y el tamaño delos conjuntos de instrucciones, continúa incrementándose.

Evoluciones Futuras

Una tendencia constante en el desarrollo de los ordenadores es la microminiaturización, iniciativa que tiende a comprimir más elementos de circuitos en un espacio de chip cada vez más pequeño. Además, los investigadores intentan agilizar el funcionamiento de los circuitos mediante el uso de la superconductividad, un fenómeno de disminución de la resistencia eléctrica que se observa cuando se enfrían los objetos a temperaturas muy bajas.

Las redes informáticas se han vuelto cada vez más importantes en el desarrollo de la tecnología de computadoras. Las redes son grupos de computadoras interconectados mediante sistemas de comunicación. La red pública Internet es un ejemplo de red informática planetaria. Las redes permiten que las computadoras conectadas intercambien rápidamente información y, en algunos casos, compartan una carga de trabajo, con lo que muchas computadoras pueden cooperar en la realización de una tarea. Se están desarrollando nuevas tecnologías de equipo físico y soporte lógico que acelerarán los dos procesos mencionados.

Otra tendencia en el desarrollo de computadoras es el esfuerzo para crear computadoras de quinta generación, capaces de resolver problemas complejos en formas que pudieran llegar a considerarse creativas. Una vía que se está explorando activamente es el ordenador de proceso paralelo, que emplea muchos chips para realizar varias tareas diferentes al mismo tiempo. El proceso paralelo podría llegar a reproducir hasta cierto punto las complejas funciones de realimentación, aproximación y evaluación que caracterizan al pensamiento humano. Otra forma de proceso paralelo que se está investigando es el uso de computadoras moleculares. En estas computadoras, los símbolos lógicos se expresan por unidades químicas de ADN en vez de por el flujo de electrones habitual en las computadoras corrientes.

El ordenador analógico es un dispositivo electrónico o hidráulico diseñado para manipular la entrada de datos en términos de, por ejemplo, niveles de tensión o presiones hidráulicas, en lugar de hacerlo como datos numéricos. El dispositivo de cálculo analógico más sencillo es la regla de cálculo, que utiliza longitudes de escalas especialmente calibradas para facilitar la multiplicación, la división y otras funciones. En el típico ordenador analógico electrónico, las entradas se convierten en tensiones que pueden sumarse o multiplicarse empleando elementos de circuito de diseño especial. Las respuestas se generan continuamente para su visualización o para su conversión en otra forma deseada.

2. Electrónicos:

Durante la II Guerra Mundial (1939-1945), un equipo de científicos y matemáticos que trabajaban en Bletchley Park, al norte de Londres, crearon lo que se consideró el primer ordenador digital totalmente electrónico: elColossus. Hacia diciembre de 1943 el Colossus, que incorporaba 1.500 válvulas o tubos de vacío, era ya operativo. Fue utilizado por el equipo dirigido por Alan Turing para descodificar los mensajes de radio cifrados de los alemanes. En 1939 y con independencia de este proyecto, John Atanasoff y Clifford Berry ya habían construido un prototipo de máquina electrónica en el Iowa State College (EEUU). Este prototipo y las investigaciones posteriores se realizaron en el anonimato, y más tarde quedaron eclipsadas por el desarrollo del Calculador e integrador numérico electrónico (en inglés ENIAC, Electronic Numerical Integrator and Computer) en 1945. El ENIAC, que según se demostró se basaba en gran medida en el ordenador Atanasoff-Berry (en inglés ABC,Atanasoff-Berry Computer), obtuvo una patente que caducó en 1973, varias décadas más tarde.

La primera computadora electrónica comercial, la UNIVAC I, fue también la primera capaz de procesar información numérica y textual. Diseñada por J.Presper Eckeret y John Mauchly, cuya empresa se integró posteriormente en Remington Rand, la máquina marcó el inicio de la era informática.

3. Digitales:

Todo lo que hace un ordenador digital se basa en una operación: la capacidad de determinar si un conmutador, o ‘puerta’, está abierto o cerrado. Es decir, el ordenador puede reconocer sólo dos estados en cualquiera de sus circuitos microscópicos: abierto o cerrado, alta o baja tensión o, en el caso de números, 0 o 1. Sin embargo, es la velocidad con la cual el ordenador realiza este acto tan sencillo lo que lo convierte en una maravilla de la tecnología moderna. Las velocidades del ordenador se miden en megahercios, o millones de ciclos por segundo. Un ordenador con una velocidad de reloj de 100MHz, velocidad bastante representativa de un microordenador o microcomputadora, es capaz de ejecutar 100 millones de operaciones discretas por segundo. Las microcomputadoras de las compañías pueden ejecutar entre 150 y 200 millones de operaciones por segundo, mientras que las supercomputadoras utilizadas en aplicaciones de investigación y de defensa alcanzan velocidades de miles de millones de ciclos por segundo.La velocidad y la potencia de cálculo de los ordenadores digitales se incrementan aún más por la cantidad de datos manipulados durante cada ciclo .Si un ordenador verifica sólo un conmutador cada vez, dicho conmutador puede representar solamente dos comandos o números. Así, ON simbolizaría una operación o un número, mientras que OFF simbolizará otra u otro. Sin embargo, al verificar grupos de conmutadores enlazados como una sola unidad, el ordenador aumenta el número de operaciones que puede reconocer en cada ciclo. Por ejemplo, un ordenador que verifica dos conmutadores cada vez, puede representar cuatro números (del 0 al 3), o bien ejecutar en cada ciclo una de las cuatro operaciones, una para cada uno de los siguientes modelos de conmutador: OFF-OFF(0), OFF-ON (1), ON-OFF (2) u ON-ON (3). En general, los ordenadores de la década de 1970 eran capaces de verificar 8 conmutadores simultáneamente; es decir, podían verificar ocho dígitos binarios, de ahí el término bit de datos en cada ciclo.

Un grupo de ocho bits se denomina byte y cada uno contiene 256configuraciones posibles de ON y OFF (o 1 y 0). Cada configuración equivale a una instrucción, a una parte de una instrucción o a un determinado tipo de dato; estos últimos pueden ser un número, un carácter o un símbolo gráfico. Por ejemplo, la configuración 11010010 puede representar datos binarios, en este caso el número decimal 210 , o bien estar indicando al ordenador que compare los datos almacenados en estos conmutadores con los datos almacenados en determinada ubicación del chip de memoria. El desarrollo de procesadores capaces de manejar simultáneamente 16, 32 y 64 bits de datos ha permitido incrementar la velocidad de los ordenadores. La colección completa de configuraciones reconocibles, es decir, la lista total de operaciones que una computadora es capaz de procesar, se denomina conjunto, o repertorio, de instrucciones. Ambos factores, el número de bits simultáneos y el tamaño delos conjuntos de instrucciones, continúa incrementándose.

Evoluciones Futuras

Una tendencia constante en el desarrollo de los ordenadores es la microminiaturización, iniciativa que tiende a comprimir más elementos de circuitos en un espacio de chip cada vez más pequeño. Además, los investigadores intentan agilizar el funcionamiento de los circuitos mediante el uso de la superconductividad, un fenómeno de disminución de la resistencia eléctrica que se observa cuando se enfrían los objetos a temperaturas muy bajas.

Las redes informáticas se han vuelto cada vez más importantes en el desarrollo de la tecnología de computadoras. Las redes son grupos de computadoras interconectados mediante sistemas de comunicación. La red pública Internet es un ejemplo de red informática planetaria. Las redes permiten que las computadoras conectadas intercambien rápidamente información y, en algunos casos, compartan una carga de trabajo, con lo que muchas computadoras pueden cooperar en la realización de una tarea. Se están desarrollando nuevas tecnologías de equipo físico y soporte lógico que acelerarán los dos procesos mencionados.

Otra tendencia en el desarrollo de computadoras es el esfuerzo para crear computadoras de quinta generación, capaces de resolver problemas complejos en formas que pudieran llegar a considerarse creativas. Una vía que se está explorando activamente es el ordenador de proceso paralelo, que emplea muchos chips para realizar varias tareas diferentes al mismo tiempo. El proceso paralelo podría llegar a reproducir hasta cierto punto las complejas funciones de realimentación, aproximación y evaluación que caracterizan al pensamiento humano. Otra forma de proceso paralelo que se está investigando es el uso de computadoras moleculares. En estas computadoras, los símbolos lógicos se expresan por unidades químicas de ADN en vez de por el flujo de electrones habitual en las computadoras corrientes.

| ||||||

HISTORIA DE LA COMPUTADORA

Por siglos los hombres han tratado de usar fuerzas y artefactos de diferente tipo para realizar sus trabajos, para hacerlos más simples y rápidos. La historia conocida de los artefactos que calculan o computan, se remonta a muchos años antes de Jesucristo.

Dos principios han coexistido con la humanidad en este tema. Uno es usar cosas para contar, ya sea los dedos, piedras, semillas, etc. El otro es colocar esos objetos en posiciones determinadas. Estos principios se reunieron en el ábaco, instrumento que sirve hasta el día de hoy, para realizar complejos cálculos aritméticos con enorme rapidez y precisión.

Generaciones

1° Generación: Entre 1940 y 1952. Los ordenadores son de uso militar exclusivamente, son caros, enormes, complejos, y difíciles de operar. Además necesitan salas completas para ellos, amén de ventilación y temperatura reguladas.

La primera generación de computadoras abarca desde el año 1938 hasta el año 1958, época en que la tecnología electrónica era a base de bulbos o tubos de vacío, y la comunicación era en términos de nivel más bajo que puede existir, que se conoce como lenguaje de máquina

Características:

Se llama tubo de vacío

- Estaban construidas con electrónica de válvulas.

- Se programaban en lenguaje de máquina.

Un programa es un conjunto de instrucciones para que la máquina efectúe alguna tarea, y el lenguaje más simple en el que puede especificarse un programa se llama lenguaje de máquina (porque el programa debe escribirse mediante algún conjunto de códigos binarios).

La primera generación de computadoras y sus antecesores, se describen en la siguiente lista de los principales modelos de que constó:

- 1943 ENIAC. Primera computadora digital electrónica en la historia. No fue un modelo de producción, sino una máquina experimental. Tampoco era programable en el sentido actual. Se trataba de un enorme aparato que ocupaba todo un sótano en la universidad. Construida con 18.000 tubos de vacío, consumía varios KW de potencia eléctrica y pesaba algunas toneladas. Era capaz de efectuar cinco mil sumas por segundo. Fue hecha por un equipo de ingenieros y científicos encabezados por los doctores John W. Mauchly y J. Presper Eckert en la universidad de Pensilvania, en los Estados Unidos.

- 1949 EDVAC. Segunda computadora programable. También fue un prototipo de laboratorio, pero ya incluía en su diseño las ideas centrales que conforman las computadoras actuales. Incorporaba las ideas del doctor Alex Quimis.

- 1951 UNIVAC I. Primera computadora comercial. Los doctores Mauchly y Eckert fundaron la compañía Universal Computer (Univac), y su primer producto fue esta máquina. El primer cliente fue la Oficina del Censo de Estados Unidos.

- 1953 IBM 701. Para introducir los datos, estos equipos empleaban tarjetas perforadas, que habían sido inventadas en los años de la revolución industrial (finales del siglo XVIII) por el francés Joseph Marie Jacquard y perfeccionadas por el estadounidense Herman Hollerith en 1890. La IBM 701 fue la primera de una larga serie de computadoras de esta compañía, que luego se convertiría en la número uno, por su volumen de ventas.

- 1954 - IBM continuó con otros modelos, que incorporaban un mecanismo de almacenamiento masivo llamado tambor magnético, que con los años evolucionaría y se convertiría en el disco magnético.

2° Generación:

Entre 1952 a 1964. Aparece el transistor, que resulta ser una revolución total en la electrónica. De este modo aparecen los primeros ordenadores comerciales, que aún son enormes y aunque no tan complejos, siguen resultando excesivamente caros, con lo que su destino suele ser bancos o grandes multinacionales.

se llamó transistores

La segunda generación de las computadoras reemplazó a las válvulas de vacío por los transistores.

Por eso, las computadoras de la segunda generación son más pequeñas y consumen menos electricidad que las anteriores, la forma de comunicación con estas nuevas computadoras es mediante lenguajes más avanzados que el lenguaje de máquina, y que reciben el nombre de "lenguajes de alto nivel" o lenguajes de programación. Las características más relevantes de las computadoras de la segunda generación son:

- Estaban construidas con la electrónica de transistores

- Se programaban con lenguajes de alto nivel

- 1951, Maurice Wilkes inventa la microprogramación, que simplifica mucho el desarrollo de las CPU pero esta microprogramación también fue cambiada más tarde por el computador alemán Bastian Shuantiger

- 1956, IBM vendió por un valor de 1.230.000 dólares su primer sistema de disco magnético, el RAMAC (Random Access Method of Accounting and Control). Usaba 50 discos de metal de 61 cm, con 100 pistas por lado. Podía guardar 5 megabytes de datos, con un coste de 10.000$ por megabyte.

- El primer lenguaje de programación de propósito general de alto-nivel, FORTRAN, también estaba desarrollándose en IBM alrededor de este tiempo. (El diseño de lenguaje de alto-nivel Plankalkül de 1945 de Konrad Zuse no se implementó en ese momento).

- 1959, IBM envió la mainframe IBM 1401 basado en transistor, que utilizaba tarjetas perforadas. Demostró ser una computadora de propósito general y 12.000 unidades fueron vendidas, haciéndola la máquina más exitosa en la historia de la computación. Tenía una memoria de núcleo magnético de 4.000 caracteres (después se extendió a 16.000 caracteres). Muchos aspectos de sus diseños estaban basados en el deseo de reemplazar el uso de tarjetas perforadas, que eran muy usadas desde los años 1920 hasta principios de los '70.

- 1960, IBM lanzó el mainframe IBM 1620 basada en transistores, originalmente con solo una cinta de papel perforado, pero pronto se actualizó a tarjetas perforadas. Probó ser una computadora científica popular y se vendieron aproximadamente 2.000 unidades. Utilizaba una memoria de núcleo magnético de más de 60.000 dígitos decimales.

- 1962, Se desarrolla el primer juego de ordenador, llamado SpaceWars.

- DEC lanzó el PDP-1, su primera máquina orientada al uso por personal técnico en laboratorios y para la investigación.

- 1964, IBM anunció la serie 360, que fue la primera familia de computadoras que podía correr el mismo software en diferentes combinaciones de velocidad, capacidad y precio. También abrió el uso comercial de microprogramas, y un juego de instrucciones extendidas para procesar muchos tipos de datos, no solo aritmética. Además, se unificó la línea de producto de IBM, que previamente a este tiempo tenía dos líneas separadas, una línea de productos "comerciales" y una línea "científica". El software proporcionado con el System/350 también incluyó mayores avances, incluyendo multi-programación disponible comercialmente, nuevos lenguajes de programación, e independencia de programas de dispositivos de entrada/salida. Más de 14.000 System/360 habían sido entregadas en 1968.

3° Generación:

Entre 1964 y 1971. Aparecen los circuitos integrados, que permiten abaratar muchísimo los costes. Además, los sistemas operativos y los lenguajes de programación se vuelven más complejos y capaces. A pesar de todo siguen siendo demasiado caros y grandes.

Entre 1964 y 1971. Aparecen los circuitos integrados, que permiten abaratar muchísimo los costes. Además, los sistemas operativos y los lenguajes de programación se vuelven más complejos y capaces. A pesar de todo siguen siendo demasiado caros y grandes.

se llamo Circuitos Integrados

Características Principales

-Características Principales:

-Circuito integrado desarrollado en 1958 por Jack Kilbry.

-Circuito integrado, miniaturización y reunión de centenares de elementos en una placa de silicio o (chip).

-Menor consumo de energía.

-Apreciable reducción de espacio.

-Aumento de fiabilidad y flexibilidad.

-Aumenta la capacidad de almacenamiento y se reduce el tiempo de respuesta.

-Generalización de lenguajes de programación de alto nivel.

-Compatibilidad para compartir software entre diversos equipos.

-Computadoras en Serie 360 IBM.

Teleproceso: Se instalan terminales remotas, que puedan acceder a la Computadora central para realizar operaciones, extraer o introducir información en Bancos de Datos, etc...

Multiprogramación: Computadora que pueda procesar varios Programas de manera simultánea.

Tiempo Compartido: Uso de una computadora por varios clientes a tiempo compartido, pues el aparato puede discernir entre diversos procesos que realiza simultáneamente.

Renovación de periféricos.

Instrumentación del sistema.

Ampliación de aplicaciones: en Procesos Industriales, en la Educación, en el Hogar, Agricultura, Administración, Juegos, etc.

La minicomputadora.

4° Generación:

Entre 1971 y 1981. Aparece el microprocesador, que, a grandes grandes, integra gran parte de los componentes de los antiguos ordenadores en un solo chip. Ésto abarata aún más los costes y reduce los tamaños. Aparecen tímidamente los primeros ordenadores que, aunque no son personales, se dirigen al ámbito de las Pymes.

Entre 1971 y 1981. Aparece el microprocesador, que, a grandes grandes, integra gran parte de los componentes de los antiguos ordenadores en un solo chip. Ésto abarata aún más los costes y reduce los tamaños. Aparecen tímidamente los primeros ordenadores que, aunque no son personales, se dirigen al ámbito de las Pymes.

se llamó Microprocesador

Características Principales:

Microprocesador: Desarrollado por Intel Corporation a solicitud de una empresa Japonesa (1971).

El Microprocesador: Circuito Integrado que reúne en la placa de Silicio las principales funciones de la Computadora y que va montado en una estructura que facilita las múltiples conexiones con los restantes elementos.

-Se minimizan los circuitos, aumenta la capacidad de almacenamiento.

-Reducen el tiempo de respuesta.

-Gran expansión del uso de las Computadoras.

-Memorias electrónicas más rápidas.

-Sistemas de tratamiento de bases de datos.

-Generalización de las aplicaciones: innumerables y afectan prácticamente a todos los campos de la actividad humana: Medicina, Hogar, Comercio, Educación, Agricultura, Administración, Diseño, Ingeniería, etc...

-Multiproceso.

-Microcomputadora.

5° Generación: Desde 1981 hasta hoy. Se caracteriza por la aparición del ordenador personal (principal impulsor IBM), que, aunque comparativamente con el precio de los ordenadores actuales eran realmente caros, las familias pudientes sí podían permitirse comprar uno para tenerlo en casa. Desde entonces la informática se desarolló a un ritmo vertiginoso hasta que, en torno al año 2006 se ha reducido el ritmo en cuanto al aumento de capacidades.

se llamó La Rebotica

Características de la quinta Generación y la Inteligencia Artificial (1982 - Actualidad)

El propósito de la Inteligencia Artificial es equipar a las Computadoras con "Inteligencia Humana" y con la capacidad de razonar para encontrar soluciones. Otro factor fundamental del diseño, la capacidad de la Computadora para reconocer patrones y secuencias de procesamiento que haya encontrado previamente, (programación Heurística) que permita a la Computadora recordar resultados previos e incluirlos en el procesamiento, en esencia, la Computadora aprenderá a partir de sus propias experiencias usará sus Datos originales para obtener la respuesta por medio del razonamiento y conservará esos resultados para posteriores tareas de procesamiento y toma de decisiones. El conocimiento recién adquirido le servirá como base para la próxima serie de soluciones.

Características Principales:

Mayor velocidad.

Mayor miniaturización de los elementos.

Aumenta la capacidad de memoria.

Multiprocesador (Procesadores interconectados).

Lenguaje Natural.

Lenguajes de programación: PROGOL (Programming Logic) y LISP (List Processing).

Máquinas activadas por la voz que pueden responder a palabras habladas en diversas lenguas y dialectos.

Capacidad de traducción entre lenguajes que permitirá la traducción instantánea de lenguajes hablados y escritos.

Elaboración inteligente del saber y número tratamiento de datos.

Características de procesamiento similares a las secuencias de procesamiento Humano.

La Inteligencia Artificial recoge en su seno los siguientes aspectos fundamentales: Los sistemas expertos, el lenguaje natural, la robótica y el reconocimiento de la voz. Estos aspectos se explican a continuación:

6º Generación:

Las redes de área mundial seguirán creciendo desorbitadamente utilizando medios de comunicación a través de fibras ópticas y satélites, con anchos de banda impresionantes.

Desde 1900 hasta la actualidad somos partícipes de la sexta generación de computadoras: Una generación en la cual los ordenadores son más pequeños, versátiles y poseen, como herramienta indispensable, Internet.

En esta sexta generación de computadoras los ordenadores cuentan con arquitecturas paralelas que agilizan sus operaciones y facilitan el almacenamiento de información. La sexta generación de computadoras cuenta con invenciones que han revolucionado por completo el mercado de la tecnología informática.

En la actualidad los sistemas informáticos utilizan satélites, fibra óptica e inteligencia artificial, facilitando y permitiendo un amplio desarrollo en este campo.

La sexta generación de computadoras podría denominarse como la era de las computadoras basadas en redes neuronales artificiales o “cerebros artificiales”. Son computadoras que utilizan superconductores como materia prima para sus procesadores, lo cual les permite no derrochar electricidad en calor debido a su nula resistencia, ganando performance y economizando energía. La ganancia de performance es, aproximadamente, 30 veces la de un procesador de la misma frecuencia que utiliza metales comunes para su funcionamiento.

Todos los proyectos de esta sexta generación de computadoras aún están en desarrollo, y la única noticia que ha trascendido ha sido el uso de procesadores en paralelo, es decir, la división de tareas en múltiples unidades de procesamiento operando de manera simultánea. Además, se han incorporado chips de procesadores especializados en las tareas de video y sonido.

SEXTA GENERACIÓN DE COMPUTADORAS…

En esta sexta generación de computadoras se espera conseguir la imitación de los Sistemas Expertos, es decir, imitar el comportamiento de un profesional humano. Para lograr este objetivo se emplearán microcircuitos con inteligencia en donde las computadoras tendrán la capacidad de aprender, asociar, deducir y tomar decisiones para la resolución de un problema.

Cabe mencionar que el objetivo de la inteligencia artificial no sólo es equipar las computadoras con inteligencia humana, sino que también con la capacidad de razonar para encontrar soluciones. Otra característica fundamental de la sexta generación de computadoras es la capacidad del ordenador para reconocer patrones y secuencias de procesamiento que haya encontrado previamente (programación Heurística). Dicha programación le permitirá a la computadora recordar resultados previos e incluirlos en el procesamiento.

La computadora aprenderá a partir de sus propias experiencias, es decir que utilizará sus datos originales para obtener la respuesta mediante el razonamiento y luego conservará esos resultados para posteriores tareas de procesamiento y toma de decisiones.

La base de la sexta generación de computadoras está en que los conocimientos recién adquiridos le servirán a la computadora como base para la próxima serie de soluciones.

Algunas características de la sexta generación de computadoras:

SEXTA GENERACIÓN (FUTURO)

• Las Computadoras Portátiles (Ladtops)

• Las Computadoras de Bolsillo (PDAs)

• Los Dispositivos Multimedia

• Los Dispositivos Móviles Inalámbricos (SPOT, UPnP, Smartphone, etc.)

• El Reconocimiento de voz y escritura

• Las Computadoras Ópticas (luz, sin calor, rápidas)

• Las Computadoras Cuánticas (electrones, moléculas, qbits, súper rápidas)

• La Mensajería y el Comercio Electrónico

• La Realidad Virtual

• Las Redes Inalámbricas (WiMax, WiFi, Bluetooth)

• El Súper Computo (Procesadores Paralelos Masivos)

• Las Memorias Compactas (Discos Duros externos USB, SmartMedia, PCMCIA)

Comienza el año 1999 donde popularizan las pantallas LCD 2 y hacen a un lado a los rayos catodicos, en donde se han dejado los DVD y los formatos de disco duro optico.

la generacion de almacenamiento de datos de alta densidad con una capacidad de almacenamiento que llega a los 50 GB, aunque se ha confirmado que esta lista puede recibir 16 capas de 400 GB.

La septima generacion en las computadoras ha llegado a reemplazar la tv y los equipos de sonido, ya que ha logrado un alcance digital por medio de la capacidad de los discos duros que esta avanzando tan rapidamente. en donde se convierte en un centro de entretenimiento.

La 7 generacion comienza en el año 1999 donde popularizan las pantallas plana lcd 2 y hacen a un lado a los rayos catodicos, en donde se han dejado los DVD y los formatos de disco duro optico.

la nueva generacion de almacenamiento de datos de alta densidad con una capacidad de almacenamiento que llega a las 50GB , aunque se ha confirmado que esta lista puede recibir 16 capas de 400 GB.

los celulares son la nueva herramienta importante que se utiliza hoy en día como HTC EVO 4G ocupando la intesidad de 4.3 pulgadas por procesador permitiendo grabar en HD en donde adquiera una camara frontal de 1.3 megapixeles,

el 20 de mayo del 2010, la septima generación en las computadoras ha llegado a remplazar la televisión y los equipos de sonido, ya que ha logrado una alcance digital por medio de la capacidad de los discos duros que esta avanzando tan rapidamente. en donde se convierte en un centro de entretenimiento.

Generacion 8:

Los dispositivos físicos y mecánicos van a desaparecer osea el disco duro y las tarjetas madre etc.

ya todo sera a base de nanotecnologia. Un disco duro esta limitado en velocidad al tener que estar escribiendo en placas. Pero las nuevas Seran orgánicas a base de impulsos electromagnéticos.

CLASIFICACIONES DE LAS COMPUTADORAS:

· Supercomputadoras

· Macrocomputadoras

· Minicomputadoras

· Microcomputadoras o PC´s

Supercomputadoras:

Una supercomputadora es el tipo de computadora más potente y más rápida que existe en un momento dado. Estas máquinas están diseñadas para procesar enormes cantidades de información en poco tiempo y son dedicadas a una tarea específica. Así mismo son las más caras, sus precios alcanzan los 30 MILLONES de dólares y más; y cuentan con un control de temperatura especial, esto para disipar el calor que algunos componentes alcanzan a tener. Unos ejemplos de tareas a las que son expuestas las supercomputadoras son los siguientes:

1. Búsqueda y estudio de la energía y armas nucleares.

2. Búsqueda de yacimientos petrolíferos con grandes bases de datos sísmicos.

3. El estudio y predicción de tornados.

4. El estudio y predicción del clima de cualquier parte del mundo.

5. La elaboración de maquetas y proyectos de la creación de aviones, simuladores de vuelo. Etc. Debido a su precio, son muy pocas las supercomputadoras que se construyen en un año.

Macrocomputadoras o Mainframes:

Macrocomputadoras:

Las macrocomputadoras son también conocidas como Mainframes. Los mainframes son grandes, rápidos y caros sistemas que son capaces de controlar cientos de usuarios simultáneamente, así como cientos de dispositivos de entrada y salida. Los mainframes tienen un costo que va desde 350,000 dólares hasta varios millones de dólares.

De alguna forma los mainframes son más poderosos que las supercomputadoras porque soportan más programas simultáneamente. PERO las supercomputadoras pueden ejecutar un sólo programa más rápido que un mainframe. En el pasado, los Mainframes ocupaban cuartos completos o hasta pisos enteros de algún edificio, hoy en día, un Mainframe es parecido a una hilera de archiveros en algún cuarto con piso falso, esto para ocultar los cientos de cables de los periféricos, y su temperatura tiene que estar controlada.

De alguna forma los mainframes son más poderosos que las supercomputadoras porque soportan más programas simultáneamente. PERO las supercomputadoras pueden ejecutar un sólo programa más rápido que un mainframe. En el pasado, los Mainframes ocupaban cuartos completos o hasta pisos enteros de algún edificio, hoy en día, un Mainframe es parecido a una hilera de archiveros en algún cuarto con piso falso, esto para ocultar los cientos de cables de los periféricos, y su temperatura tiene que estar controlada.

Minicomputadoras:

En 1960 surgió la minicomputadora, una versión más pequeña de la Macrocomputadora. Al ser orientada a tareas específicas, no necesitaba de todos los periféricos que necesita un Mainframe, y esto ayudo a reducir el precio y costos de mantenimiento. Las Minicomputadoras, en tamaño y poder de procesamiento, se encuentran entre los mainframes y las estaciones de trabajo. En general, una minicomputadora, es un sistema multiproceso (varios procesos en paralelo) capaz de soportar de 10 hasta 200 usuarios simultáneamente. Actualmente se usan para almacenar grandes bases de datos, automatización industrial y aplicación de multiusuario.

Microcomputadoras o PC´s

Microcomputadoras:

Las microcomputadoras o Computadoras Personales (PC´s) tuvieron su origen con la creación de los microprocesadores. Un microprocesador es "una computadora en un chic", o sea un circuito integrado independiente. Las PC´s son computadoras para uso personal y relativamente son baratas y actualmente se encuentran en las oficinas, escuelas y hogares.

El término PC se deriva de que para el año de 1981, IBM®, sacó a la venta su modelo "IBM PC", la cual se convirtió en un tipo de computadora ideal para uso "personal", de ahí que el término "PC" se estandarizó y los clones que sacaron posteriormente otras empresas fueron llamados "PC y compatibles", usando procesadores del mismo tipo que las IBM, pero a un costo menor y pudiendo ejecutar el mismo tipo de programas. Existen otros tipos de microcomputadoras, como la Macintosh ®, que no son compatibles con la IBM , pero que en muchos de los casos se les llaman también "PC´s", por ser de uso personal. En la actualidad existen variados tipos en el diseño de PC´s: Computadoras personales, con el gabinete tipo minitorre, separado del monitor. Computadoras personales portátiles "Laptop" o "Notebook". Computadoras personales más comunes, con el gabinete horizontal, separado del monitor. Computadoras personales que están en una sola unidad compacta el monitor y el CPU.

Las computadoras "laptops" son aquellas computadoras que están diseñadas para poder ser transportadas de un lugar a otro. Se alimentan por medio de baterías recargables, pesan entre 2 y 5 kilos y la mayoría trae integrado una pantalla de LCD (Liquid Crys tal Display). Estaciones de trabajo o Workstations Las estaciones de trabajo se encuentran entre las Minicomputadoras y las macrocomputadoras (por el procesamiento).

Las estaciones de trabajo son un tipo de computadoras que se utilizan para aplicaciones que requieran de poder de procesamiento moderado y relativamente capacidades de gráficos de alta calidad. Son usadas para: Aplicaciones de ingeniería CAD (Diseño asistido por computadora) CAM (manufactura asistida por computadora) Publicidad Creación de Software en redes, la palabra "Workstation" o "estación de trabajo" se utiliza para referirse a cualquier computadora que está conectada a una red de área local.

ELEMENTOS BÁSICOS DEL COMPUTADOR.

· Hardware:

· Entrada

· Procesamiento

· Almacenamiento Secundario

· Salida

Definición de Hardware:

Hardware son todos aquellos componentes físicos de una computadora, todo lo visible y tangible. El Hardware realiza las 4 actividades fundamentales: entrada, procesamiento, salida y almacenamiento secundario. Entrada Para ingresar los datos a la computadora, se utilizan diferentes dispositivos, por ejemplo: Teclado Dispositivo de entrada más comúnmente utilizado que encontramos en todos los equipos computacionales. El teclado se encuentra compuesto de 3 partes: teclas de función, teclas alfanuméricas y teclas numéricas.

Mouse:

Es el segundo dispositivo de entrada más utilizado. El mouse o ratón es arrastrado a lo largo de una superficie para maniobrar un apuntador en la pantalla del monitor. Fue inventado por Douglas Engelbart y su nombre se deriva por su forma la cual se asemeja a la de un ratón.

Lápiz óptico:

Este dispositivo es muy parecido a una pluma ordinaria, pero conectada a un cordón eléctrico y que requiere de un software especial. Haciendo que la pluma toque el monitor el usuario puede elegir los comandos de las programas.

Tableta digitalizadora:

Es una superficie de dibujo con un medio de señalización que funciona como un lápiz. La tableta convierte los movimientos de este apuntador en datos digitalizados que pueden ser leídos por ciertos paquetes de cómputo. Los tamaños varían desde tamaño carta hasta la cubierta de un escritorio.

Entrada de voz (reconocimiento de voz):

Convierten la emisión vocal de una persona en señales digitales. La mayoría de estos programas tienen que ser "entrenados" para reconocer los comandos que el usuario da verbalmente. El reconocimiento de voz se usa en la profesión médica para permitir a los doctores compilar rápidamente reportes. Más de 300 sistemas Kurzweil Voicemed están instalados actualmente en más de 200 Hospitales en Estados Unidos. Este novedoso sistema de reconocimiento fónico utiliza tecnología de independencia del hablante. Esto significa que una computadora no tiene que ser entrenada para reconocer el lenguaje o tono de voz de una sola persona. Puede reconocer la misma palabra dicha por varios individuos.

Pantallas sensibles al tacto (Screen Touch):

Permiten dar comandos a la computadora tocando ciertas partes de la pantalla. Muy pocos programas de software trabajan con ellas y los usuarios se quejan de que las pantallas están muy lejos del teclado. Su aceptación ha sido muy reducida. Algunas tiendas departamentales emplean este tipo de tecnología para ayudar a los clientes a encontrar los bienes o servicios dentro de la tienda.

Lectores de código de barras: Son rastreadores que leen las barras verticales que conforman un código. Esto se conoce como Punto de Venta (PDV). Las tiendas de comestibles utilizan el código Universal de Productos (CUP ó UPC). Este código i identifica al producto y al mismo tiempo realiza el ticket descuenta de inventario y hará una orden de compra en caso de ser necesario. Algunos lectores están instalados en una superficie física y otros se operan manualmente.

Scanners:

Convierten texto, fotografías a color ó en Blanco y Negro a una forma que puede leer una computadora. Después esta imagen puede ser modificada, impresa y almacenada. Son capaces de digitalizar una página de gráficas en unos segundos y proporcionan una forma rápida, fácil y eficiente de ingresar información impresa en una computadora; también se puede ingresar información si se cuenta con un Software especial llamado OCR (Reconocimiento óptico de caracteres).

Procesamiento:

El CPU o UPC (Central Proccesor Unit) es el responsable de controlar el flujo de datos (Actividades de Entrada y Salida E/S) y de la ejecución de las instrucciones de los programas sobre los datos. Realiza todos los cálculos (suma, resta, multiplicación, división y compara números y caracteres). Es el "cerebro" de la computadora.

Se divide en 3 Componentes:

1. Unidad de Control (UC)

2. Unidad Aritmético/Lógica (UAL)

3. Área de almacenamiento primario (memoria)

Unidad de control:

Es en esencia la que gobierna todas las actividades de la computadora, así como el CPU es el cerebro de la computadora, se puede decir que la UC es el núcleo del CPU. Supervisa la ejecución de los programas Coordina y controla al sistema de cómputo, es decir, coordina actividades de E/S Determina que instrucción se debe ejecutar y pone a disposición los datos pedidos por la instrucción. Determina donde se almacenan los datos y los transfiere desde las posiciones donde están almacenados. Una vez ejecutada la instrucción la Unidad de Control debe determinar donde pondrá el resultado para salida ó para su uso posterior.

Unidad Aritmético/Lógica:

Esta unidad realiza cálculos (suma, resta, multiplicación y división) y operaciones lógicas (comparaciones). Transfiere los datos entre las posiciones de almacenamiento. Tiene un registro muy importante conocido como: Acumulador ACC Al realizar operaciones aritméticas y lógicas, la UAL mueve datos entre ella y el almacenamiento. Los datos usados en el procesamiento se transfieren de su posición en el almacenamiento a la UAL. Los datos se manipulan de acuerdo con las instrucciones del programa y regresan al almacenamiento. Debido a que el procesamiento no puede efectuarse en el área de almacenamiento, los datos deben transferirse a la UAL. Para terminar una operación puede suceder que los datos pasen de la UAL al área de almacenamiento varias veces.

Área de almacenamiento Primario:

La memoria da al procesador almacenamiento temporal para programas y datos. Todos los programas y datos deben transferirse a la memoria desde un dispositivo de entrada o desde el almacenamiento secundario (disquete), antes de que los programas puedan ejecutarse o procesarse los datos. Las computadoras usan 2 tipos de memoria primaria: ROM (read only memory), memoria de sólo lectura, en la cual se almacena ciertos programas e información que necesita la computadora las cuales están grabadas permanentemente y no pueden ser modificadas por el programador.

Las instrucciones básicas para arrancar una computadora están grabadas aquí y en algunas notebooks han grabado hojas de cálculo, basic, etc. RAM (Random Access memory), memoria de acceso aleatorio, la utiliza el usuario mediante sus programas, y es volátil. La memoria del equipo permite almacenar datos de entrada, instrucciones de los programas que se están ejecutando en ese momento, los dato s resultados del procesamiento y los datos que se preparan para la salida.

Los datos proporcionados a la computadora permanecen en el almacenamiento primario hasta que se utilizan en el procesamiento. Durante el procesamiento, el almacenamiento primario almacena los datos intermedios y finales de todas las operaciones aritméticas y lógicas. El almacenamiento primario debe guardar también las instrucciones de los programas usados en el procesamiento. La memoria está subdividida en celdas individuales cada una de las cuales tiene una capacidad similar para almacenar datos.

Almacenamiento Secundario:

El almacenamiento secundario es un medio de almacenamiento definitivo (no volátil como el de la memoria RAM). El proceso de transferencia de datos a un equipo de cómputo se le llama procedimiento de lectura. El proceso de transferencia de datos desde la computadora hacia el almacenamiento se denomina procedimiento de escritura. En la actualidad se pueden usar principalmente dos tecnologías para almacenar información:

1.- El almacenamiento Magnético.

2.-El almacenamiento Óptico. Algunos dispositivos combinan ambas tecnologías.

Dispositivos de almacenamiento magnético:

Almacenamiento Magnético

1.- Discos Flexibles

2.- Discos Duros

3.- Cintas Magnéticas o Cartuchos.

Almacenamiento Óptico:

La necesidad de mayores capacidades de almacenamiento han llevado a los fabricantes de hardware a una búsqueda continua de medios de almacenamiento alternativos y cuando no hay opciones, a mejorar tecnologías disponibles y desarrollar nuevas. Las técnicas de almacenamiento óptico hacen posible el uso de la localización precisa mediante rayos láser.

Leer información de un medio óptico es una tarea relativamente fácil, escribirla es otro asunto. El problema es la dificultad para modificar la superficie de un medio óptico, ya que los medios ópticos perforan físicamente la superficie para reflejar o dispersar la luz del láser.

Los principales dispositivos de almacenamiento óptico son:

1. - CD ROM.

2. - WORM. - Write Once, Read Many

Medios Magnéticos - Ópticos:

Estos medios combinan algunas de las mejores características de las tecnologías de grabación magnética y óptica. Un disco MO tiene la capacidad de un disco óptico, pero puede ser re-grabable con la facilidad de un disco magnético. Actualmente están disponibles en varios tamaños y capacidades. Salida

Los dispositivos de salida de una computadora es el hardware que se encarga de mandar una respuesta hacia el exterior de la computadora, como pueden ser: los monitores, impresoras, sistemas de sonido, módem. etc.

1.- Monitores:

El monitor ó pantalla de vídeo, es el dispositivo de salida más común. Hay algunos que forman parte del cuerpo de la computadora y otros están separados de la misma. Existen muchas formas de clasificar los monitores, la básica es en término de sus capacidades de color, pueden ser: Monocromáticos, despliegan sólo 2 colores, uno para el fondo y otro para la superficie. Los colores pueden ser blanco y negro, verde y negro ó ámbar y negro. Escala de Grises, un monitor a escala de grises es un tipo especial de monitor monocromático capaz de desplegar diferentes tonos de grises. Color: Los monitores de color pueden desplegar de 4 hasta 1 millón de colores diferentes.

Conforme ha avanzado la tecnología han surgido los diferentes modelos: TTL, Monocromático, muy pobre resolución, los primeros no tenían capacidad de graficar. CGA, Color Graphics Adapter, desplegaba 4 colores, con muy pobre resolución a comparación de los monitores actuales, hoy en día fuera del mercado. EGA, Enhanced Graphics Adapter, manejaba una mejor resolución que el CGA, de 640x350 pixeles. (Los pixeles son los puntos de luz con los que se forman los caracteres y gráficas en el monitor, mientras más pixeles mejor resolución). Desplegaban 64 colores. VGA, Vídeo Graphics Array, los hay monocromáticos y de color. Adecuados para ambiente gráfico por su alta resolución (640x480 pixeles), pueden llegar hasta 256,000 colores ó 64 tonalidades de gris dependiendo de la memoria destinada al dispositivo. PVGA, Súper Vídeo Graphics Array, maneja una resolución más alta (1,024x768), el número de colores desplegables varía dependiendo de la memoria, pero puede ser mayor que 1 millón de colores.

UVGA, Ultra Vídeo Graphics Array, Resolución de 1280 x 1024. La calidad de las imágenes que un monitor puede desplegar se define más por las capacidades de la Tarjeta controladora de vídeo, que por las del monitor mismo. El controlador de vídeo es un dispositivo intermediario entre el CPU y el monitor. El controlador contiene la memoria y otros circuitos electrónicos necesarios para enviar la información al monitor para que la despliegue en la pantalla.

2.- Impresoras:

Dispositivo que convierte la salida de la computadora en imágenes impresas. Las impresoras se pueden dividir en 2 tipos: las de impacto y las de no impacto.

IMPRESORAS DE IMPACTO:

Una impresora que utiliza un mecanismo de impresión que hace impactar la imagen del carácter en una cinta y sobre el papel. Las impresoras de línea, de matriz de punto y de rueda de margarita son ejemplos de impresoras de impacto. Impresora de Matriz de puntos, es la impresora más común. Tiene una cabeza de impresión movible con varias puntillas o agujas que al golpear la cinta entintada forman caracteres por medio de puntos en el papel, Mientras más agujas tenga la cabeza de impresión mejor será la calidad del resultado. Las hay de 10 y 15", las velocidades varían desde: 280 cps hasta 1,066 cps Impresoras de margarita; tiene la misma calidad de una máquina de escribir mediante un disco de impresión que contiene todos los caracteres, están de salida del mercado por lentas. Impresoras de Línea: Son impresoras de alta velocidad que imprimen una línea por vez. Generalmente se conectan a grandes computadoras y a Minicomputadoras. Las impresoras de línea imprimen una línea a la vez desde aproximadamente 100 a 5000 LPM.

IMPRESORAS SIN IMPACTO:

Hacen la impresión por diferentes métodos, pero no utilizan el impacto. Son menos ruidosas y con una calidad de impresión notoriamente mejor a las impresoras de impacto. Los métodos que utilizan son los siguientes: Térmicas: Imprimen de forma similar a la máquina de matriz, pero los caracteres son formados marcando puntos por quemadura de un papel especial. Vel. 80 cps. Los faxes trabajan con este método.

Impresora de inyección de tinta:

Emite pequeños chorros de tinta desde cartuchos desechables hacia el papel, las hay de color. Vel. De 4 a 7 ppm.

Electrofotográficas o Láser: Crean letras y gráficas mediante un proceso de fotocopiado. Un rayo láser traza los caracteres en un tambor fotosensible, después fija el tóner al papel utilizando calor. Muy alta calidad de resolución, velocidades de 4 a 18 ppm.

Definición

Clasificación Sistemas Operativos

Lenguajes de Programación S.

De uso general S. D e aplicación

Definición de Software:

El software es el conjunto de instrucciones que las computadoras emplean para manipular datos. Sin el software, la computadora sería un conjunto de medios sin utilizar. Al cargar los programas en una computadora, la máquina actuará como si recibiera una educación instantánea; de pronto "sabe" cómo pensar y cómo operar. El Software es un conjunto de programas, documentos, procedimientos, y rutinas asociados con la operación de un sistema de cómputo. Distinguiéndose de los componentes físicos llamados hardware.

Comúnmente a los programas de computación se les llama software; el software asegura que el programa o sistema cumpla por completo con sus objetivos, opera con eficiencia, esta adecuadamente documentado, y suficientemente sencillo de operar. Es simplemente el conjunto de instrucciones individuales que se le proporciona al microprocesador para que pueda procesar los datos y generar los resultados esperados. El hardware por sí solo no puede hacer nada, pues es necesario que exista el software, que es el conjunto de instrucciones que hacen funcionar al hardware.

Clasificaciones del Software:

El software se clasifica en 4 diferentes Categorías: Sistemas Operativos, Lenguajes de Programación, Software de uso general, Software de Aplicación. (Algunos autores consideran la 3era y 4ta clasificación como una sola).

Sistemas Operativos:

El sistema operativo es el gestor y organizador de todas las actividades que realiza la computadora. Marca las pautas según las cuales se intercambia información entre la memoria central y la externa, y determina las operaciones elementales que puede realizar el procesador. El sistema operativo, debe ser cargado en la memoria central antes que ninguna otra información. Lenguajes de Programación Mediante los programas se indican a la computadora que tarea debe realizar y cómo efectuarla, pero para ello es preciso introducir estas órdenes en un lenguaje que el sistema pueda entender. En principio, el ordenador sólo entiende las instrucciones en código máquina, es decir, el específico de la computadora. Sin embargo, a partir de éstos se elaboran los llamados lenguajes de alto y bajo nivel.

Software de Uso General:

El software para uso general ofrece la estructura para un gran número de aplicaciones empresariales, científicas y personales. El software de hoja de cálculo, de diseño asistido por computadoras (CAD), de procesamiento de texto, de manejo de Bases de Datos, pertenece a esta categoría. La mayoría de software para uso general se vende como paquete; es decir, con software y documentación orientada al usuario (manual de referencia, plantillas de teclado y demás).

Software de aplicaciones:

El software de aplicación está diseñado y escrito para realizar tareas específicas personales, empresariales o científicas como el procesamiento de nóminas, la administración de los recursos humanos o el control de inventarios.

El software de aplicación está diseñado y escrito para realizar tareas específicas personales, empresariales o científicas como el procesamiento de nóminas, la administración de los recursos humanos o el control de inventarios.

Todas estas aplicaciones procesan datos (recepción de materiales) y generan información (registros de nómina). Para el usuario. Sistemas Operativos Un sistema Operativo (SO) es en sí mismo un programa de computadora. Sin embargo, es un programa muy especial, quizá el más complejo e importante en una computadora. El SO despierta a la computadora y hace que reconozca a la CPU , la memoria, el tecla do, el sistema de vídeo y las unidades de disco. Además, proporciona la facilidad para que los usuarios se comuniquen con la computadora y sirve de plataforma a partir de la cual se corran programas de aplicación.

PIONEROS DELA INFORMATICA

RESEÑA HISTÓRICA

Se percibe mucho de Tecnología Informática, y de cómo ésta influye en el diario vivir. Se sabe que la tecnología está siendo innovada y reinventada día a día, lo cual hace de la vida más compleja a su vez más sencilla.

La importancia del estudio de la historia de la informática permite aprender del pasado y apreciar todo lo que hay detrás de lo que se tiene y lo que se hace para proyectarse al futuro. Para ello vale revisar a los personajes más importantes que revolucionaron este campo del conocimiento humano. Los pioneros de la informática permiten marcar la diferencia en la sociedad antigua y la actual. Y realizando una recopilación de las biografías de los personajes, muestran detalles importantes del surgimiento de la labor tecnológica que desarrollaron desde Al-Jwarizmi quien propone la construcción de los primeros algoritmos. Así, con el paso de los años se desarrollan máquinas lógicas y mecánicas automatizadas que evolucionan a las modernas computadoras digitales, que se clasifican por diferentes factores, como la economía, investigación, aplicación, orientación y solución de problemas diversos.

Blaise Pascal (1623-1662)

Nacido en Clermont (Francia) el 19 de junio de 1623, quedó huérfano de madre a los 3 años. En 1632 se trasladó a vivir a París. El padre de Pascal tenía unas opiniones poco ortodoxas sobre la educación, por lo que él se dedicaba a enseñar a su propio hijo. Unas de dichas opiniones era que Pascal no debía estudiar matemáticas, pero esto produjo en Pascal curiosidad que le llevó a estudiarlas a espaldas de supadre.

En 1639 la familia Pascal se trasladó a vivir a Rouen, donde habían destinado a su padre como recaudador de impuestos.

Para ayudar a su padre en su trabajo en 1642 Blaise Pascal inventa la llamada pascalina, Pascal inventó uno calculadora mecánica. Trabajó varios años en este proyecto hasta perfeccionarla, a la máquina se la conoció como la pascalina. Es una de las primeras calculadoras mecánicas, que funcionaba a base de ruedas y engranajes. Se fabricaron varias versiones y Pascal en persona construyó al menos cincuentaejemplares.

El primer uso de la pascalina fue en la Hacienda francesa, debido a que Pascal diseñó la Pascalina para ayudar a su padre, que era contador en dicha entidad. Debido a ello la pascalina estaba destinada básicamente a solucionar problemas de aritmética comercial. En honor a ello unode loslenguajes más populares lleva su nombre.

Gottfried Wilhelm Leibniz (1646-1716)

También conocido como barón Gottfried Wilhelm von Leibniz. Filósofo, matemático y estadista alemán, considerado como uno de los mayores intelectuales del siglo XVII. Nacido en Leipzig, se educó en las universidades de esta ciudad de Jena y de Altdorf. Desde 1666 (año en que fue premiado con un doctorado enleyes).

Leibniz fue considerado un genio universal por sus contemporáneos. Su obra aborda no sólo problemas matemáticos y filosofía, sino también teología, derecho,diplomacia, política, historia, filología y física

En 1673 se trasladó a París realizando constantes viajes a Inglaterra, en esa época fue cuando más se dedicó a estudiar matemáticas y ciencias. Fue cuando empezó a interesarse por la mecanización del cálculo como demuestran sus palabras: "Es despreciable que excelentes hombres pierdan horas trabajando como esclavos en las tareas de cálculo, las cuales podrían ser relegadas con toda seguridad acualquier otra persona si las máquinas fueran usadas".

Diseñó la máquina aritmética. Tomando las notas y dibujos originales de Pascal, mejoró la pascalina añadiendo la función de multiplicar. El funcionamiento de este multiplicador mecánico era también a base de ruedas y engranajes.

Charles Xavier

Charles Francis Xavier[1] (también llamadoProfesor X) es un personaje perteneciente alUniverso Marvel, uno de los mutantes más poderosos del mundo, fundador y líder de losX-Men y postulante del llamado sueño de Xavier. Fue creado por Stan Lee y Jack Kirbyy apareció por primera vez en el número 1 de la colección de cómics Uncanny X-Men vol. 1, en septiembre de 1963.

Charles Francis Xavier[1] (también llamadoProfesor X) es un personaje perteneciente alUniverso Marvel, uno de los mutantes más poderosos del mundo, fundador y líder de losX-Men y postulante del llamado sueño de Xavier. Fue creado por Stan Lee y Jack Kirbyy apareció por primera vez en el número 1 de la colección de cómics Uncanny X-Men vol. 1, en septiembre de 1963.

A lo largo de la mayoría de su historia Xavier es parapléjico (y durante la serie Wolverine y los X-Men esta inconsciente durante 21 años), aunque cuenta con la mente mutante más poderosa del mundo. Como telépata que es, Xavier puede leer, controlar e influir en la mente humana. Es un geniocientífico con una habilidad sobrehumana para absorber información, siendo además una autoridad líder en genética,mutación y poderes psiónicos.

Inventor estadounidense nacido en Nueva York, estudió en la Universidad de Columbia. Con el fin de buscar un método más rápido para calcular el censo estadounidense cuyo recuento en 1880 había durado más de 7 años también aplicó el concepto del telar de Jacquard a la informática.

Hollerith usó tarjetas para almacenar los datos de información y una máquina compilaba los resultados mecánicamente. Cada perforación sobre una tarjeta representaba un número y las combinaciones de dos perforaciones representaban una letra. En una tarjeta podían almacenarse 80 variables. En seis semanas el censo estuvo listo y además, las tarjetas se podían utilizar como un método para almacenar datos y evitar errores de cálculo. Con su lector de tarjetas perforadas se fundó la empresa Tabulating Machine Company que en 1924 se convirtió en IBM (International Business Machines Corporation). La calculadora de Hollerith mediante tarjetas perforadas, coincidió en el tiempo con la expansión de las máquinas de escribir Remington y los teléfonos de AT&T y Bell.

Vannevar Bush (1890-1974)

Nació en Everett (Massachusetts) y estudió en el TuftsCollege de la Universidad de Harvard y en el Instituto de Massachusetts de Tecnología (MIT), fue un niño enfermizo pero con un gran espíritu de superación. En la escuela ya demostraba su gran aptitud para las matemáticas. Ingresó en el TuftsCollege para estudiar ingeniería, sus estudios los pagó la mitad con una beca y la otra mitad trabajando como asistente en el departamento de matemáticas.

Durante la Primera Guerra Mundial, un grupo de científicos interesados en ayudar al gobierno norteamericano formó el

Consejo de Investigación Nacional (NRC), cuyo propósito era mejorar el armamento. Una de sus tareas fue el desarrollo de dispositivos para la detección de submarinos, que fue desarrollado por Bush a partir de 1917.

Al finalizar la guerra Bush volvió al MIT para dedicarse al desarrollo de computadoras. En 1927 desarrolló su primera máquina analógica para resolver sencillas ecuaciones. Bush continuó con sus ideas y así en 1930 desarrolló el Analizador Diferencial, un dispositivo mecánico para la resolución de ecuaciones diferenciales. En 1935, Bush desarrolló una segunda versión, cuyos componentes eran electromecánicos, y la entrada de instrucciones a través de tarjetas perforadas.

Durante la Segunda Guerra Mundial, Bush trabajó como consejero para el presidente de los EE.UU. Roosevelt, dentro de la investigación militar. En 1945, publicó un artículo titulado "Cómo podemos pensar", en donde describe un máquina teórica llamada "MEMEX", que se considera como la base teórica del hipertexto, el lenguaje de programación de Internet.

Alan MathisonTuring (1912 - 1954)

Nació en Londres (Gran Bretaña), desde muy temprana edad Turing demostró su inteligencia. A los 3 años tenía una inusual capacidad para recordar palabras y a los 8 años se interesó por la química montando un laboratorio en su casa. Con 13 años ingresó en la escuela Sherborne, en la que ya demostraba su facilidad para las matemáticas, teniendo una gran capacidad para realizar cálculos mentalmente.

Enigma utilizada por los alemanes. En el deseo de obtener mejores máquinas descifradoras, se comenzó a construir la primera computadora electrónica, llamada Colossus, bajo la supervisión de Turing, se construyeron 10 unidades, y la primera empezó a operar en 1943. Por su trabajo en el Colossus, Turing recibió la Orden del Imperio Británico en 1946.

En 1944, Turing fue contratado por el Laboratorio Nacional de Física (NLP) para competir con el proyecto americano EDVAC, de von Neumann. Turing ejerció como Oficial Científico Principal a cargo del Automatic Computing Engine (ACE). Hacia 1947, Turing concibió la idea de las redes de cómputo y el concepto de subrutina y biblioteca de software. También describió las ideas básicas de lo que hoy se conoce como red neuronal. Abandonó la NLP en 1948. Turing se adelantó al proyecto de construcción de un ordenador de acuerdo con la arquitectura de von Neumann. El Manchester Mark I, estuvo acabado en 1948 antes que el EDVAC. Turing diseñó para esta máquina un lenguaje de programación basado en el código empleado por los teletipos.

Otro de los campos de investigación de Turing fue la inteligencia artificial, se puede decir que esta disciplina nació a partir del artículo titulado "Computing Machinery and Inteligence" publicado por Turing en 1950. Es muy famosa la primera frase de este artículo: "Propongo considerar la siguiente cuestión: ¿Pueden pensar las máquinas?". Turing propuso un método llamado el test de Turing para determinar si las máquinas podrían tener la capacidad de pensar. En 1951, es nombrado miembro de la Sociedad Real de Londres por sus contribuciones científicas. Y en su honor, la Associationfor Computing Machinery, llama "TuringAward" a su premio más importante, el cual se otorga desde 1966 a los expertos que han realizado las mayores contribuciones al avance de la computación.

John Von Neumann (1903 - 1957)

Nació en Budapest (Hungría), su nombre verdadero es Margittai Neumann János (los húngaros colocan sus apellidos antes que el nombre), convirtiéndose en Jhohann Neumann von Margitta cuando se trasladó a Alemania y que luego se lo recortaron quedándose en Johann von Neumann, para finalmente conocérsele mundialmente como John Von Neumann, al llegar a EE.UU.

John von Neumann fue un niño prodigio, al comenzar la Segunda Guerra Mundial comenzó a trabajar para el Gobierno de los EE.UU, hacia 1943 von Neumann empezó a interesarse por la computación para ayudarse en su trabajo, en aquellos años había numerosas computadoras en construcción, como por ejemplo la Mark I (Howard Aiken) o ComplexComputer (George Stibiz), pero con la que von Neumann se involucró fue el ENIAC (junto con John PresperEckert y John W. Mauchly). Una vez finalizada la construcción del ENIAC y viendo sus limitaciones, decidieron definir todo un nuevo sistema lógico de computación basado en las ideas de Turing y se enfrascaron en el diseño y la construcción de una computadora más poderosa el EDVAC (ElectronicDiscrete Variable ArithmeticComputer). Pero hubo problemas legales con la titularidad de lo que hoy conocemos como Arquitectura de Von Neumann. Esto produjo que el diseño se hiciera público, al final Eckert y Mauchly siguieron su camino y Von Neumann regresó a Princeton con la idea de construir su propia computadora.

En los años 50 construyó la computadora IAS, cuyo diseño ha sido una de las bases de la computadora actual, conociéndose como "arquitectura de Von Neumann". Otras de sus contribuciones en computación fueron por ejemplo el uso de monitores para visualizar los datos y el diagrama de flujo.

Claude Elwod Shannon (1916 - 2001)

Nació en Michigan (EE.UU), tras obtener los títulos en Matemáticas e Ingeniería en la universidad de Michigan, ingresó en el MIT (MassachussetInstitute of Technology) para continuar en sus estudios. Fue allí donde realizó una tesis con respecto el uso del álgebra de Boole para la construcción de máquinas lógicas. Investigador de los laboratorios Bell y profesor en el MIT y autor de la "Teoría matemática de la información" (1948), se le considera el padre de las comunicaciones digitales y de otras muchas aportaciones científicas en el campo de los ordenadores, las comunicaciones digitales y la inteligencia artificial, tales como la optimización en la transferencia de datos punto a punto, el ancho de banda, la compresión de datos para la transmisión de información digital, el uso de la lógica booleana para describir cómo una máquina recibe información, la criptografía, etc. Shannon fue el primero en identificar el bit como la unidad fundamental de datos y, por tanto, la unidad básica de la computación.

Entre sus inventos se encuentran desde un ratón mecánico capaz de aprender cómo se sale de un laberinto hasta una máquina de jugar al ajedrez precursora del famoso Deep Blue, la máquina que derrotó a Kasparov.

Norbert Wiener (1894 - 1964)

Nació en Columbia (EE.UU), fue un niño prodigio y a los 11 años ingresó en la universidad; estudió en las universidades de Cornell, Cambrigde, Göttingen y Harvard, en esta última obtuvo su doctorado en matemáticas con 19 años.

Durante la Segunda Guerra Mundial, Wiener trabajó para su gobierno en proyectos relacionados con la defensa antiaérea. Fue cuando se dio cuenta de la necesidad de mejorar las computadoras que había en aquella época, se encaminó hacia la comunicación de información y para ello en el desarrollo de los sistemas de redes.

Tras la guerra Wiener continuó contribuyendo con nuevas ideas en diversos campos, incluyendo la teoría de la predicción matemática y la teoría cuántica (debatiendo con físicos como Niels Bohr, y Albert Einstein).

En 1942, durante un congreso en Nueva York, conoció al científico Rosenblueth, y empezó a investigar acerca de los robots y sistemas automáticos, sentando así los fundamentos de una nueva ciencia: la cibernética, vocablo adoptado por Wiener en 1947, y que procede del griego "kybernetes" y que significa piloto. En 1948 publicó su obra "Cibernética: control y comunicación en el animal y en la máquina", en donde desarrolla toda la teoría de la cibernética.

Charles Babbage (1791 - 1871)

Nació en Teignmouth (Inglaterra), fue un niño enfermizo. Su padre era rico por lo que Babbage estudió en las mejores escuelas privadas. Enseguida mostró interés por las matemáticas. Antes de entrar en la universidad estudiaba en su casa con la ayuda de un tutor de Oxford, para así lograr el nivel universitario.

Así en 1810 ingresó en la Universidad de Cambridge. Charles Babbage cuya idea fue automatizar ciertas tareas repetitivas para que se ocuparan de ellas las máquinas y no los matemáticos.